Deterministische Workflows sind das Rückgrat professioneller Rechtspraxis – KI-Halluzinationen können dieses Fundament erschüttern.

KI-Halluzinationen gefährden die Reproduzierbarkeit anwaltlicher Workflows durch unvorhersagbare Abweichungen bei der Dokumentenextraktion. Kleinere, spezialisierte Sprachmodelle erzielen oft deterministischere Ergebnisse als große Universalmodelle. Technische Parameter wie Temperature-Einstellungen reduzieren die Kreativität der KI und erhöhen die Vorhersagbarkeit. Mehrstufige Validierungsverfahren durch Quervalidierung, logische Plausibilitätsprüfungen und fachliche Nachrechnung schaffen Verlässlichkeit. Statistische Überprüfungen von Prompt-Änderungen sichern die Konsistenz der Extraktion ab.

Was sind KI-Halluzinationen?

KI-Halluzinationen bezeichnen Ausgaben von Sprachmodellen, die plausibel erscheinen, aber faktisch falsch oder erfunden sind. In der anwaltlichen Praxis manifestieren sich diese Fehler besonders kritisch bei der Extraktion von Informationen aus Rechtsdokumenten. Ein Sprachmodell könnte beispielsweise ein Aktenzeichen als „123 C 456/23“ ausgeben, obwohl im Original „123 C 465/23“ steht. Der Fehler wirkt unauffällig, führt aber zu schwerwiegenden Folgefehlern.

Die Probabilistik moderner Large Language Models verstärkt dieses Problem. Die Modelle generieren Antworten basierend auf Wahrscheinlichkeitsverteilungen, nicht auf deterministischen Regeln. Bei der Extraktion von Vertragsdaten kann dasselbe Modell für identische Dokumente unterschiedliche Ergebnisse liefern. Diese Inkonsistenz untergräbt die Reproduzierbarkeit, die für rechtliche Workflows essentiell ist.

Besonders problematisch sind sogenannte „konfabulative Halluzinationen“. Das Modell erfindet scheinbar logische Informationen, die im Quelldokument nicht existieren. Bei der Analyse von Gerichtsurteilen könnte eine KI beispielsweise Rechtsgrundsätze hinzufügen, die nie genannt wurden. Diese erfundenen Inhalte integrieren sich nahtlos in den Output und bleiben oft unentdeckt.

Die Häufigkeit von Halluzinationen variiert stark zwischen verschiedenen Modelltypen und Anwendungsszenarien. Aktuelle Studien zeigen, dass spezialisierte Modelle für Dokumentenextraktion deutlich weniger anfällig sind als Allzweckmodelle. Dies erklärt, warum kleinere, fokussierte Sprachmodelle in der Kanzleipraxis oft bessere Ergebnisse erzielen als ihre größeren Gegenstücke.

| Halluzinationstyp | Beispiel | Auswirkung | Erkennbarkeit |

|---|---|---|---|

| Numerische Verfälschung | Aktenzeichen 123/23 wird zu 132/23 | Falsche Zuordnung | Schwer erkennbar |

| Datumsfehler | 15.03.2024 wird zu 15.03.2023 | Fristversäumnisse | Mittel erkennbar |

| Konfabulative Ergänzung | Erfindung nicht existierender Paragraphen | Rechtliche Fehlberatung | Sehr schwer erkennbar |

| Kontextuelle Verschiebung | Zuordnung von Aussagen zu falschen Personen | Mandantenverwechslung | Schwer erkennbar |

| Formatierungsfehler | Umwandlung von Aufzählungen in Fließtext | Informationsverlust | Leicht erkennbar |

Die Auswirkungen reichen weit über einzelne Extraktionsfehler hinaus. In automatisierten Workflows propagieren sich Halluzinationen durch nachgelagerte Prozesse. Eine falsch extrahierte Frist führt zu fehlerhaften Kalendereinträgen, falschen Erinnerungen und letztendlich zu Versäumnissen. Die Fehlerfortpflanzung macht Halluzinationen zu einem systemischen Risiko für die gesamte Kanzleiorganisation.

Risiken für Kanzleien

Die Integration von KI-Systemen in Kanzleien schafft neue Haftungsrisiken, die über traditionelle Beratungsfehler hinausgehen. Halluzinationen bei der Dokumentenextraktion können zu Berufshaftpflichtschäden führen, die sich nur schwer vorhersagen lassen. Anders als menschliche Fehler folgen KI-Halluzinationen keinen erkennbaren Mustern. Ein Anwalt kann auch bei erfahrenster Rechtspraxis von diesen Problemen überrascht werden.

Fristversäumnisse durch falsch extrahierte Daten stellen das gravierendste Risiko dar. Wenn ein Sprachmodell ein Berufungsurteil mit dem Datum „15.03.2024“ statt „15.02.2024“ extrahiert, verschiebt sich die Revisionsfrist um einen Monat. Der Mandant verliert seine Rechtsmittel, ohne dass der Fehler zunächst erkennbar wäre. Die Berufshaftpflicht trägt den Schaden, aber der Reputationsverlust bleibt bestehen.

Mandantenverwechslungen durch kontextuelle Halluzinationen bedrohen die anwaltliche Verschwiegenheitspflicht. Ein Sprachmodell könnte bei der Extraktion von E-Mail-Anhängen Informationen zwischen verschiedenen Mandanten vertauschen. Vertrauliche Daten landen in falschen Akten. Die Aufdeckung solcher Fehler kann Monate dauern, während sensible Informationen falsch zugeordnet bleiben.

Kostenrisiken entstehen durch fehlerhafte RVG-Berechnungen bei automatisierten Abrechnungssystemen. Halluzinationen bei der Extraktion von Streitwerten oder Verfahrensarten führen zu falschen Gebührenpositionen. Zu niedrige Abrechnungen bedeuten Honorarverluste. Zu hohe Forderungen provozieren Mandantenbeschwerden und Vergütungsrückforderungen der Rechtsschutzversicherungen.

Eine Kanzlei nutzt KI zur Extraktion von Vertragsdaten. Das System interpretiert eine Kündigungsklausel falsch und gibt eine Kündigungsfrist von „3 Monaten“ statt „6 Monaten“ aus. Der automatisch generierte Kündigungsschriftsatz verwendet die falsche Frist. Der Mandant kündigt zu früh, der Vertrag läuft weiter, Mehrkosten von 50.000 Euro entstehen.

Qualitätsmängel in der Schriftsatzerstellung durch halluzinierte Rechtsprechungshinweise kompromittieren die fachliche Reputation. Wenn eine KI nicht existierende Urteile zitiert oder Rechtsgrundsätze verfälscht wiedergibt, fallen diese Fehler oft erst vor Gericht auf. Der Richter erkennt die erfundenen Zitate, die Glaubwürdigkeit der Kanzlei leidet nachhaltig.

Compliance-Verstöße durch fehlerhafte Dokumentenklassifikation können zu aufsichtsrechtlichen Konsequenzen führen. Bei der automatisierten Geldwäscheprüfung könnte eine KI relevante Verdachtsmomente übersehen oder falsch kategorisieren. Die Meldepflichten werden verletzt, Bußgelder und Reputationsschäden drohen.

| 23%Anteil der Kanzleien mit KI-bedingten FehlernLegal Tech Survey 2024 | €85.000Durchschnittlicher Schaden pro Vorfall | 4,2 MonateMittlere Aufdeckungszeit |

Die Skalierung von KI-Systemen verstärkt diese Risiken exponentiell. Ein einzelner Halluzinationsfehler kann hunderte von Dokumenten gleichzeitig betreffen. Bei der Massenbearbeitung von Mietverträgen könnte ein systematischer Extraktionsfehler zu falschen Miethöhen in allen bearbeiteten Fällen führen. Die Korrektur wird aufwendig und kostspielig.

Besonders kritisch sind Halluzinationen in zeitkritischen Verfahren. Einstweilige Verfügungen und Eilverfahren lassen keine Zeit für umfangreiche Validierungen. Fehlerhafte KI-Extraktionen können hier zu irreversiblen Schäden führen. Die Balance zwischen Geschwindigkeit und Genauigkeit wird zur zentralen Herausforderung für Kanzleiinhaber.

Validierung und Kontrolle

Systematische Validierungsverfahren bilden das Fundament für verlässliche KI-Dokumentenextraktion. Der erste Baustein besteht in der statistischen Überprüfung von Prompt-Änderungen über definierte Testfälle. Jede Modifikation am Prompt wird gegen einen standardisierten Satz von Referenzdokumenten getestet. Die Konsistenz der Ergebnisse bestimmt die Qualität der Anpassung.

Ein strukturierter Testdatensatz sollte mindestens 100 repräsentative Dokumente aus verschiedenen Rechtsbereichen umfassen. Für Arbeitsrecht gehören Arbeitsverträge, Kündigungen, Abmahnungen und Zeugnisse dazu. Jedes Dokument wird manuell annotiert, um Referenzwerte für die automatische Extraktion zu schaffen. Diese Ground Truth bildet die Basis für statistische Qualitätsmessungen.

Die Konsistenzmessung erfolgt über mehrfache Extraktionen desselben Dokuments mit identischen Parametern. Schwankt das Ergebnis zwischen den Durchläufen, deutet dies auf Instabilitäten im Modellverhalten hin. Eine Abweichung von mehr als 5% bei numerischen Werten oder strukturellen Änderungen bei Textextraktionen erfordert eine Überarbeitung der Prompt-Strategie.

Mehrstufige Quervalidierung reduziert systematische Fehler durch den Einsatz verschiedener Validierungsansätze. Die erste Stufe nutzt ein zweites, unabhängiges Sprachmodell zur Überprüfung kritischer Extraktionen. Unterscheiden sich die Ergebnisse beider Modelle erheblich, wird eine manuelle Prüfung ausgelöst. Diese Redundanz fängt modellspezifische Halluzinationen ab.

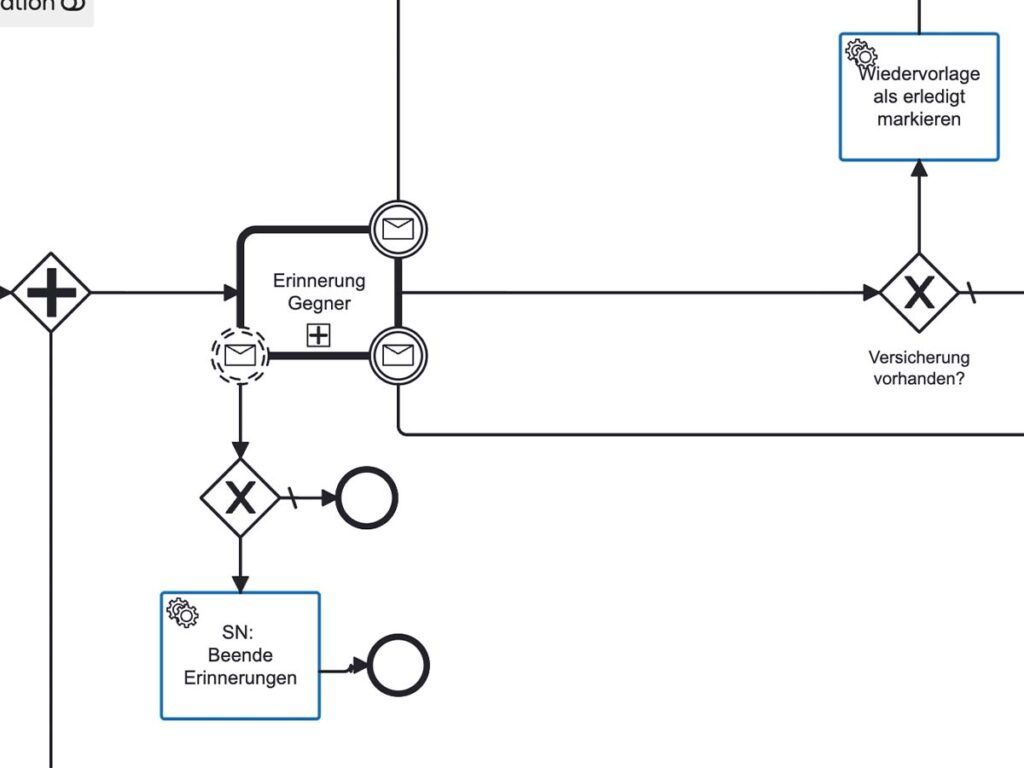

Logische Plausibilitätsprüfungen bilden die zweite Validierungsebene. Bei Gerichtsverfahren muss das Urteilsdatum nach der Klageschrift liegen. Berufungsfristen beginnen mit der Zustellung, nicht mit der Verkündung. Diese zeitlogischen Abhängigkeiten lassen sich automatisiert prüfen. Verstöße gegen solche Regeln decken häufig Halluzinationen auf.

Fachliche Nachrechnung stellt die dritte Validierungsstufe dar. RVG-Gebühren, Prozesskosten und Zinsberechnungen folgen exakten mathematischen Regeln. Die extrahierten Werte werden gegen diese Berechnungsvorschriften geprüft. Abweichungen von mehr als einem Euro bei Gebührenberechnungen erfordern eine manuelle Nachkontrolle.

| Datentyp | Primärvalidierung | Sekundärvalidierung | Akzeptable Fehlerquote | Kritikalität |

|---|---|---|---|---|

| Aktenzeichen | Format-Regex | Cross-Model-Check | 0% | Kritisch |

| Fristen/Daten | Datumslogik | Zeitliche Plausibilität | 0% | Kritisch |

| Geldbeträge | Numerische Validierung | Berechnungsrückprüfung | 0,1% | Hoch |

| Personendaten | Konsistenzprüfung | Mandantenzuordnung | 1% | Hoch |

| Textpassagen | Längenvalidierung | Semantische Ähnlichkeit | 5% | Mittel |

| Kategorisierung | Schema-Validierung | Confidence-Score | 10% | Niedrig |

Die statistische Qualitätskontrolle erfordert kontinuierliche Überwachung der Extraktionsqualität. Precision- und Recall-Werte werden für jeden Datentyp separat gemessen. Ein Rückgang der Precision unter 95% bei kritischen Feldern wie Aktenzeichen oder Fristen löst automatisch eine Systemwarnung aus. Die Kanzlei kann sofort reagieren und die Extraktion pausieren.

Besonders wichtig ist die Erkennung von systematischen Drifteffekten. Änderungen in der Dokumentenstruktur oder neue Formulierungen können die Extraktionsqualität schleichend verschlechtern. Wöchentliche Qualitätsreports zeigen Trends in der Fehlerverteilung auf. Steigt die Fehlerquote in bestimmten Dokumententypen an, werden die entsprechenden Prompts angepasst.

Die Implementierung automatischer Stichprobenkontrollen ergänzt die systematischen Validierungsverfahren. Mindestens 10% aller Extraktionen durchlaufen eine manuelle Nachprüfung durch qualifizierte Mitarbeiter. Diese Stichproben werden stratifiziert ausgewählt, um alle Dokumententypen und Komplexitätsstufen abzudecken. Die Ergebnisse fließen in die kontinuierliche Verbesserung der KI-Systeme ein.

Technische Schutzmaßnahmen

Die Auswahl des optimalen Sprachmodells stellt den ersten kritischen Entscheidungspunkt dar. Entgegen der intuitive Annahme liefern kleinere, spezialisierte Modelle oft deterministischere Ergebnisse als große Universalmodelle. Ein für Rechtsdokumente trainiertes 7B-Parameter-Modell kann konsistentere Extraktionen erzielen als ein 175B-Parameter-Allzweckmodell. Die geringere Komplexität reduziert unvorhersagbare Verhaltensweisen.

Die sorgfältige Konfiguration der Modellparameter beeinflusst maßgeblich die Vorhersagbarkeit der Ausgaben. Der Temperature-Parameter kontrolliert die Kreativität des Modells. Für Dokumentenextraktion sollte die Temperature auf 0.0 oder maximal 0.1 gesetzt werden. Dies eliminiert zufällige Variationen und fördert reproduzierbare Ergebnisse. Top-k und Top-p Sampling werden deaktiviert, um deterministisches Verhalten zu erzwingen.

Prompt Engineering erfordert präzise, eindeutige Anweisungen ohne Interpretationsspielräume. Mehrdeutige Formulierungen wie „extrahiere wichtige Informationen“ führen zu inkonsistenten Ergebnissen. Stattdessen definieren strukturierte Prompts exakte Felder, Formate und Validierungsregeln. JSON-Schema-basierte Ausgabeformate reduzieren Formatierungsfehler und erleichtern die nachgelagerte Verarbeitung.

| Parameter | Empfohlener Wert | Auswirkung | Begründung |

|---|---|---|---|

| Temperature | 0.0 – 0.1 | Minimale Kreativität | Reproduzierbare Extraktionen |

| Top-k | Deaktiviert | Deterministisches Sampling | Eliminiert Zufallsvariation |

| Top-p | Deaktiviert | Strikte Token-Auswahl | Verhindert unwahrscheinliche Ausgaben |

| Max Tokens | Exakt kalkuliert | Vollständige Extraktion | Vermeidet Abschneidungen |

| Repetition Penalty | 1.0 | Natürliche Wiederholungen | Erlaubt korrekte Duplikate |

| Frequency Penalty | 0.0 | Keine Frequenzbeschränkung | Korrekte multiple Vorkommen |

Few-Shot-Prompting mit sorgfältig ausgewählten Beispielen stabilisiert die Extraktionsqualität. Die Beispiele müssen die vollständige Bandbreite der zu verarbeitenden Dokumente abdecken. Ein Arbeitsvertragsextraktions-Prompt sollte Beispiele für Vollzeit-, Teilzeit- und Minijob-Verträge enthalten. Die Beispiele werden regelmäßig aktualisiert, um neue Dokumentenvarianten zu berücksichtigen.

Strukturierte Ausgabeformate mit strikten Schema-Validierungen fangen Formatierungsfehler ab, bevor sie in nachgelagerte Systeme propagieren. JSON-Schema oder XML-DTDs definieren exakte Feldtypen, Wertebereiche und Pflichtfelder. Ein Schema für RVG-Extraktionen würde numerische Felder für Gebühren, Datumsfelder für Fristen und Enum-Werte für Verfahrensarten vorschreiben.

Konfidenz-Scoring ermöglicht die automatische Identifikation unsicherer Extraktionen. Modelle mit nativer Konfidenz-Ausgabe markieren zweifelhafte Ergebnisse. Bei selbst entwickelten Lösungen kann die Konfidenz über Token-Probabilitäten approximiert werden. Extraktionen mit niedriger Konfidenz durchlaufen automatisch eine manuelle Überprüfung.

KI Benchmarking vergleicht verschiedene Modelle anhand allgemeiner Fähigkeiten. Produktive Qualitätskontrolle misst dagegen die Zuverlässigkeit für spezifische Anwendungsfälle. Benchmark-Sieger sind nicht automatisch die beste Wahl für Kanzlei-Workflows. Determinismus und Konsistenz wiegen oft schwerer als rohe Intelligenz.

Ensemble-Methoden kombinieren mehrere Modelle oder Extraktionsansätze für robustere Ergebnisse. Ein Voting-System aus drei verschiedenen Modellen kann Einzelfehler abfangen. Stimmen mindestens zwei Modelle überein, wird das Ergebnis akzeptiert. Bei Uneinigkeit erfolgt eine manuelle Prüfung. Diese Redundanz erhöht die Systemkosten, aber reduziert kritische Fehler erheblich.

Regelbasierte Post-Processing-Pipeline ergänzen die KI-Extraktion um deterministische Validierungsschritte. Regex-Pattern prüfen Aktenzeichen-Formate, Datumsvalidierungen erkennen unmögliche Termine, mathematische Berechnungen verifizieren Summen. Diese hybriden Ansätze kombinieren die Flexibilität von KI mit der Verlässlichkeit von Regeln.

Kontinuierliches Monitoring der Modellperformance erkennt Qualitätsverschlechterungen frühzeitig. Drift-Detection-Algorithmen überwachen Veränderungen in der Eingabeverteilung und Ausgabequalität. Steigt die Fehlerquote bei bestimmten Dokumententypen, werden automatisch Warnungen ausgelöst. Die Kanzlei kann rechtzeitig das Modell retunieren oder die Prompts anpassen.

Technische Schutzmaßnahmen sind nur so stark wie ihre schwächste Komponente. Eine Kombination aus mehreren Ansätzen – deterministische Konfiguration, strukturierte Validierung und kontinuierliche Überwachung – schafft robuste Systeme für die anwaltliche Praxis.

Die Implementierung von A/B-Testing für Prompt-Änderungen verhindert qualitätsmindernde Modifikationen. Neue Prompt-Versionen werden zunächst parallel zur Produktionsversion getestet. Statistische Signifikanztests bestimmen, ob Änderungen tatsächliche Verbesserungen bringen. Nur validiert bessere Versionen ersetzen das Produktionssystem. Dieser wissenschaftliche Ansatz verhindert subjektive Verschlechterungen durch gefühlte Optimierungen.

Fazit und Empfehlungen

Die Qualität der KI-Dokumentenextraktion bildet das Fundament für alle nachgelagerten Automatisierungsschritte in der Kanzlei. Halluzinationen in der Eingangsstufe propagieren sich durch gesamte Workflows und können schwerwiegende rechtliche und wirtschaftliche Konsequenzen haben. Eine systematische Herangehensweise an die Halluzinationsprävention ist daher nicht optional, sondern geschäftskritisch für moderne Kanzleien.

Die Erkenntnisse aus der Praxis zeigen deutlich, dass kleinere, spezialisierte Sprachmodelle oft bessere Ergebnisse für deterministische Anwendungen liefern als große Universalmodelle. Die Verlockung, das neueste und größte verfügbare Modell einzusetzen, sollte der nüchternen Bewertung von Konsistenz und Vorhersagbarkeit weichen. Ein 7B-Parameter-Modell mit deterministischen Einstellungen übertrifft häufig 100B-Parameter-Modelle in der praktischen Anwendung.

Die Implementierung mehrstufiger Validierungsverfahren erweist sich als unverzichtbar für produktive KI-Systeme. Quervalidierung durch verschiedene Modelle, logische Plausibilitätsprüfungen und fachliche Nachrechnung schaffen redundante Sicherheitsebenen. Diese Mehrfach-Validierung erhöht zwar die Systemkomplexität, reduziert aber das Risiko kritischer Fehler um Größenordnungen.

Sofortige Maßnahmen: Temperature auf 0.0 setzen, strukturierte Ausgabeformate definieren, manuelle Stichprobenkontrollen etablieren. Mittelfristige Projekte: Referenzdatensatz aufbauen, mehrstufige Validierung implementieren, kontinuierliche Qualitätsüberwachung einführen. Strategische Weichenstellungen: Spezialisierte Modelle evaluieren, hybride Regel-KI-Systeme entwickeln, fachliche Expertise in Validierungsprozesse integrieren.

Statistische Qualitätskontrolle muss als kontinuierlicher Prozess verstanden werden, nicht als einmalige Konfiguration. Die regelmäßige Überprüfung von Prompt-Änderungen gegen standardisierte Testfälle verhindert qualitätsmindernde Anpassungen. Kanzleien sollten mindestens monatliche Qualitätsreviews etablieren und bei kritischen Anwendungen wöchentliche Kontrollen implementieren.

Die Investition in robuste Validierungssysteme zahlt sich langfristig aus. Während die initiale Entwicklung mehrstufiger Prüfverfahren aufwendig erscheint, reduzieren sie das Haftungsrisiko erheblich und schaffen Vertrauen in automatisierte Prozesse. Mandanten und Gerichte akzeptieren KI-unterstützte Arbeit eher, wenn transparente Qualitätssicherungsmechanismen existieren.

Besondere Aufmerksamkeit verdient die Behandlung zeitkritischer Verfahren. Einstweilige Verfügungen und Eilanträge erfordern spezielle Workflows mit beschleunigter Validierung. Hier können Ensemble-Methoden mit mehreren parallelen Modellen die Validierungsgeschwindigkeit erhöhen, ohne die Qualität zu kompromittieren. Die Kosten für redundante Systeme wiegen die Risiken verspäteter Anträge auf.

Hybride Ansätze, die KI-Flexibilität mit regelbasierten Sicherheitsnetzen kombinieren, stellen den aktuellen Stand der Technik dar. Deterministische Nachbearbeitung durch Regex-Validierung, mathematische Plausibilitätsprüfungen und logische Konsistenzkontrollen ergänzen probabilistische KI-Ausgaben optimal. Diese Kombination nutzt die Stärken beider Ansätze und kompensiert ihre jeweiligen Schwächen.

Die kontinuierliche Weiterbildung des Kanzleipersonals in KI-Qualitätskontrolle wird zum Wettbewerbsfaktor. Mitarbeiter müssen verstehen, wie sie KI-Ausgaben kritisch bewerten und Halluzinationen erkennen können. Regelmäßige Schulungen zu neuen Validierungsmethoden und Qualitätsindikatoren sichern die fachliche Kompetenz im Umgang mit automatisierten Systemen.

Der Aufbau institutionellen Wissens über bewährte Praktiken in der KI-Qualitätssicherung stärkt die Wettbewerbsposition. Kanzleien, die früh systematische Validierungsverfahren etablieren, können diese Expertise als Differenzierungsmerkmal nutzen. Mandanten bevorzugen zunehmend Kanzleien mit nachweislich robusten Automatisierungsprozessen.