“

Erstmals systematisch: 30 KI-Modelle im juristischen Benchmark-Test. Gleichzeitig fordern Einkäufer auf der Legalweek 2026 Praxis-Nachweise statt Marketing-Versprechen. Der Moment, in dem Behauptungen nicht mehr ausreichen.

Es gibt einen Moment in der Reifung jeder Technologiebranche, der vorhersehbar ist, aber trotzdem regelmäßig überrascht:

den Moment, in dem jemand anfängt zu messen.

In der Legal-KI-Branche ist dieser Moment gerade angekommen.

Am 14. und 15. März 2026 fand in Berlin, München und online der Benchathon statt — das erste systematische Forschungsprojekt, das misst, wie gut KI im juristischen Kontext im Vergleich zu echten Juristen funktioniert. Rund 30 KI-Sprachmodelle wurden auf juristische Aufgaben in drei Varianten getestet: allgemeine LLMs, spezialisierte Legal-KI-Tools und menschliche Juristen als Referenz. Die Initiatorengruppe formulierte das Ziel klar:

Die Diskussion von subjektiven Einschätzungen hin zu messbaren Ergebnissen verlagern.

Gleichzeitig, auf der Legalweek 2026 in New York: Einkäufer von Legal-Tech-Lösungen formulierten nach Berichten der Teilnehmer erstmals in dieser Deutlichkeit, was sie von Anbietern erwarten. Nicht Feature-Demos. Nicht Case Studies. Task-level evidence, traceability of outputs, clarity on data handling.

Das ist ein Paradigmenwechsel. Und er hat Konsequenzen.

01

Der Legal AI Benachathon

Das erste systematische Messverfahren für juristische KI

Das Benchathon-Projekt greift ein Problem auf, das in der Branche lange bekannt, aber nie systematisch adressiert wurde: Es gibt keine verlässliche, unabhängige Grundlage dafür, wie gut eine juristische KI wirklich funktioniert.

Anbieter veröffentlichen eigene Benchmarks — unter optimalen Bedingungen, mit kurzen Dokumenten, klar definierten Aufgaben. Diese Zahlen sind keine Lüge. Sie sind aber auch nicht die Realität des Produktivbetriebs. Der Benchathon versucht, diese Lücke zu schließen: echte juristische Aufgaben, echte Juristen als Referenz, systematische Vergleichbarkeit.

Was der Benchathon misst — Aufgabentypen und Methodik |

Drei Varianten: allgemeine LLMs / spezialisierte Legal-KI / menschliche Juristen als Referenz |

Aufgabentypen: Rechtliche Analyse, Dokumentenprüfung, Fallzusammenfassung, Rechtsrecherche |

Ca. 30 KI-Sprachmodelle im Vergleich |

Ergebnisse werden systematisch ausgewertet und veröffentlicht |

Langfristiges Ziel: Benchmark als dauerhafter Standard für juristische KI-Evaluation |

Veranstalter: Forschungsgruppe Legal Tech Deutschland, Berlin und München, 14./15. März 2026 |

Die ersten Ergebnisse waren zum Zeitpunkt dieses Artikels noch nicht vollständig publiziert. Aber die Richtung, die der Benchathon einschlägt, ist wichtig — unabhängig von spezifischen Zahlen. Weil er eine Infrastruktur für Vergleichbarkeit schafft, die vorher nicht existiert hat.

02

Halluzinationen

Halluzinationsraten jenseits der Marketing-Versprechen

Während der Benchathon die erste systematische Brancheninitiative aus Deutschland ist, gibt es internationale Forschung, die zeigt, was messbare Vergleiche ergeben können. Eine Stanford-Studie aus 2024, die rund 800.000 Anfragen ausgewertet hat, kommt zu Ergebnissen, die erheblich von den Vendor-Benchmarks abweichen.

Vendor-Benchmarks (kontrollierte Bedingungen) | Stanford-Ergebnisse (komplexe juristische Aufgaben) |

Allg. LLMs: unter 1 % Halluzinationsrate | Allg. LLMs: 58–88 % Halluzinationsrate |

Westlaw AI: zuverlässige Rechtsrecherche | Westlaw AI-Assisted Research: 34 % Fehlerrate |

Lexis+ AI: präzise Zitatfindung | Lexis+ AI: 17 % Fehlerrate |

Legal KI: deutlich besser als allg. LLMs | Spezialisierte Tools besser, aber weit von ‚zuverlässig‘ |

Diese Zahlen sagen nicht: Legal KI ist wertlos. Sie sagen: Die Verlässlichkeit von Legal KI hängt stark vom Aufgabentyp ab. Für einfache, klar definierte Aufgaben ist KI zuverlässig und wertvoll. Für komplexe Mehrquellen-Synthesen und jurisdiktionsspezifische Zitatsuche — also genau das, was in einem echten Schriftsatz gebraucht wird — sind Fehlerraten inakzeptabel hoch.

Das ist kein Argument gegen KI. Es ist ein Argument für den richtigen Einsatz von KI — in klar definierten, überprüfbaren Schritten, mit menschlichem Review dort, wo die Fehlerwahrscheinlichkeit hoch ist.

03

Was der Markt fordert

Praxis statt Feature-Demos.

Auf der Legalweek 2026 in New York zeichnete sich ein Konsens ab, der für Legal-Tech-Anbieter bedeutsam ist. KPMG Law Global Legal Solutions fasste es so zusammen: „By 2026, legal AI will be judged less on interface quality and more on operational discipline: evaluation, auditability, and predictable behaviour in real legal workflows.“

Und weiter: „Procurement will harden, with buyers demanding task-level evidence, traceability of outputs, and clarity on data handling rather than generic capability claims.“

Was Einkäufer auf der Legalweek 2026 fordern |

Task-level evidence: Wie gut funktioniert das Tool bei dieser spezifischen Aufgabe in meiner Umgebung? |

Traceability: Kann ich nachvollziehen, wie das System zu diesem Output gekommen ist? |

Data handling clarity: Wie werden meine Mandantendaten verarbeitet, gespeichert, genutzt? |

Auditability: Kann ich im Nachhinein beweisen, was das System wann entschieden hat? |

Predictability: Verhält sich das System konsistent — oder variiert der Output bei gleicher Eingabe? |

Das ist die Einkäuferperspektive von 2026. Und sie hat nichts mehr mit dem zu tun, was Legal-Tech-Demos in 2022 oder 2023 gezeigt haben. Damals war die Frage: Kann die KI so etwas machen? Heute ist die Frage: Kann ich beweisen, dass sie es richtig gemacht hat?

04

KI muss Erwartungen erfüllen

Hyped, aber realistisch.

Der Benchathon und die Legalweek-Signale zusammen beschreiben denselben Prozess: Eine Branche, die aus der Phase der Begeisterung in die Phase der Überprüfung übergeht. Das passiert in jeder Technologiebranche — und es hat immer dieselbe Konsequenz: Anbieter, die Behauptungen mit Evidenz unterlegen können, setzen sich durch. Anbieter, die es nicht können, verschwinden.

Forrester hat das so formuliert: „The AI hype period ends.“ 25 Prozent des geplanten KI-Spend wird auf 2027 verschoben, weil Käufer ROI-Evidenz verlangen, die viele Anbieter nicht liefern können. Gartner ergänzt: Über 40 Prozent der Agentic-AI-Projekte werden bis 2027 eingestellt — zu hohe Kosten, zu wenig nachweisbarer Wert.

05

Die DEPLAW Perspektive

KI, aber mit Praxisnutzen.

Es gibt eine Frage, die wir uns bei der Entwicklung von DEPLAW gestellt haben — und die wir heute noch stellen:

Wenn ein Partner oder Mandant fragt, welche Entscheidung das System wann auf Basis welcher Daten getroffen hat, können wir das beantworten?

Die Antwort muss Ja sein. Nicht als Ziel. Als Grundvoraussetzung.

Wer KI-Outputs nicht zurückverfolgen kann, kann sie nicht verteidigen. Wer sie nicht verteidigen kann, sollte sie nicht in rechtlich relevante Prozesse einbetten. Das ist kein radikaler Standpunkt — das ist die logische Konsequenz aus dem, was Gerichte gerade entscheiden und was Einkäufer gerade fordern.

The question has shifted from ‚Does your platform use AI?‘ to ‚Can your AI withstand scrutiny if challenged?‘ That is a hallucination question. Most current legal AI valuations have not priced in a credible answer. — Development Corporate, März 2026 |

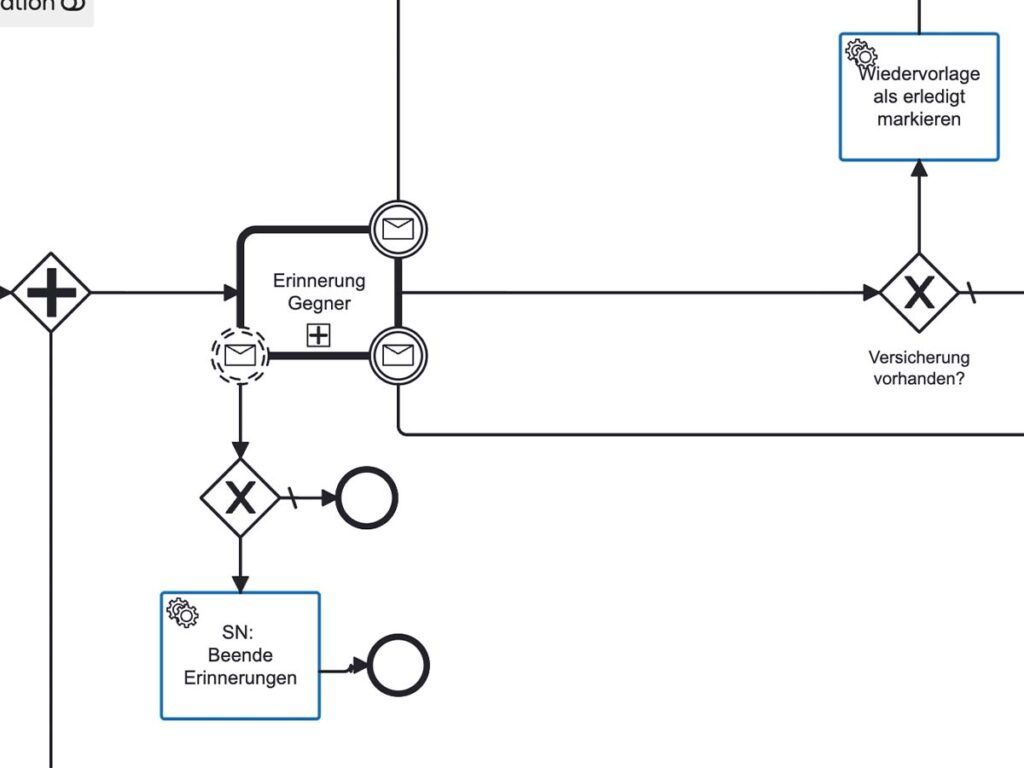

In DEPLAW ist jede KI-Aktion ein dokumentierter Task. Die revisionssichere Prozesshistorie protokolliert Modell, Eingabe, Ergebnis und Zeitstempel. Der Workflow-Editor macht die Prozesslogik explizit und versioniert. Das Leistungsdashboard zeigt Fehlerquoten und Durchlaufzeiten in Echtzeit.

Das ist task-level evidence. Das ist Auditierbarkeit. Das ist Predictability.

Der Moment, in dem Legal KI gemessen wird, ist jetzt. Die Frage ist, ob die Infrastruktur, auf der man KI einsetzt, einer Überprüfung standhält. Diese Frage zu beantworten, sollte nicht erst dann passieren, wenn jemand danach fragt.

Quellen & Nachweise [1] Legal Tech Verzeichnis (März 2026): Benchathon zur Vermessung der Legal KI — 14./15. März 2026. legal-tech-verzeichnis.de [2] Stanford Law School / RegLab (2024): Hallucination-Free? Profiling Legal Hallucinations in Large Language Models. Oxford Journal of Legal Analysis. [3] KPMG Law Global Legal Solutions (2026): 2026 Prediction — Legal AI judged on operational discipline. natlawreview.com [4] Development Corporate (25. März 2026): AI Hallucinations in Legal Filings — The question shifts to scrutiny. developmentcorporate.com [5] Legal IT Insider (17. März 2026): BLTF 2026 — Leaving AI feature race for AI deployment era. legaltechnology.com [6] Forrester Research (2026): The AI Hype Period Ends — 25 % AI-Spend-Verschiebung auf 2027. [7] Gartner (2026): 40 % Agentic-AI-Projekte bis 2027 eingestellt — Kosten und Wert. [8] National Law Review (2026): 85 Predictions for AI and the Law in 2026. natlawreview.com |